Retirado do portal OUTRAS PALAVRAS

por Archon Fung e Lawrence Lessig

Tradução: Antonio Martins

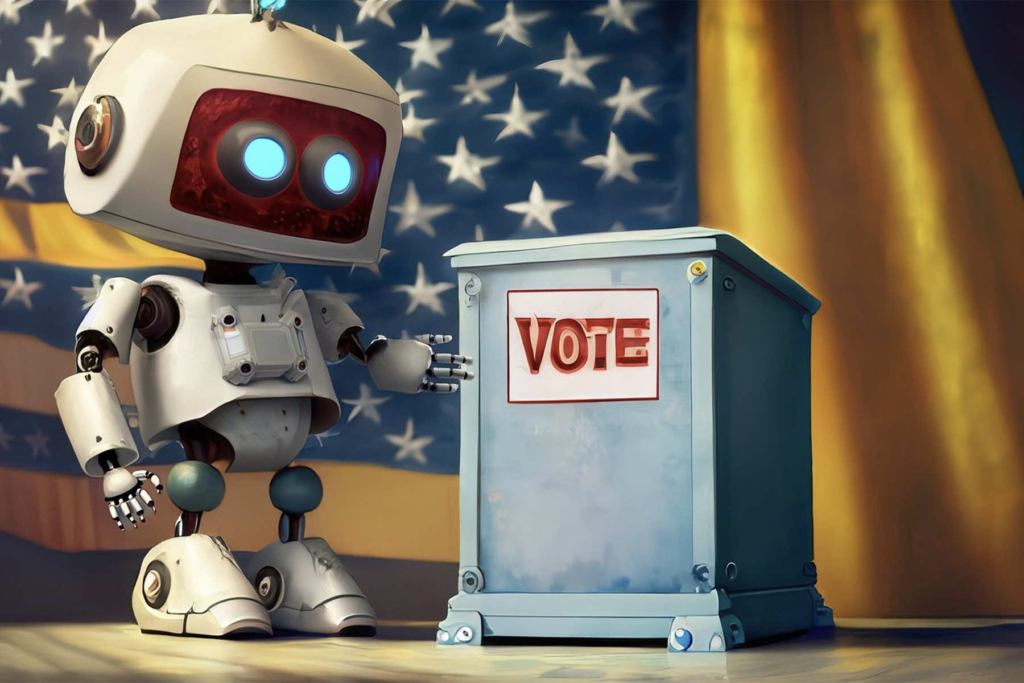

Como a manipulação da realidade e o microdirecionamento das campanhas podem desfigurar eleições e governos? Dois grandes estudiosos dos sistemas políticos chegam a conclusões sombrias – e propõem regulamentação imediata

Que tipo de organização poderia usar modelos de linguagem de inteligência artificial, como o ChatGPT, para induzir os eleitores a se comportarem de maneiras específicas?

Em 16/5, o senador norte-americano Josh Hawley fez esta pergunta ao executivo-chefe da OpenAI, Sam Altman, em uma audiência do Congresso dos EUA sobre inteligência artificial. Altman respondeu que estava de fato preocupado com a possibilidade de algumas pessoas usarem modelos de linguagem para manipular, persuadir e se envolver em interações individuais com os eleitores.

Altman não entrou em detalhes, mas ele poderia ter em mente algo parecido com o cenário descrito a seguir. Imagine que em breve os tecnólogos políticos desenvolvam uma máquina chamada Clogger – uma fábrica de campanhas políticas em uma caixa-preta. O Clogger persegue obsessivamente um único objetivo: ampliar ao máximo as chances de que seu candidato – a campanha que compra os serviços da Clogger Inc. – vença uma eleição.

Plataformas como Facebook, Twitter e YouTube usam formas de IA para fazer com que os usuários passem mais tempo em seus sites. Mas a IA do Clogger teria um objetivo diferente: mudar o comportamento eleitoral das pessoas.

Como o Clogger funcionaria

Em nossa condição de cientista político e de jurista, estudamos a interseção entre tecnologia e democracia. Acreditamos que algo como o Clogger poderia usar a automação para aumentar de modo dramático a escala e a eficácia da manipulação de comportamento e das técnicas de microdirecionamento que as campanhas políticas têm usado desde o início dos anos 2000. Assim como os anunciantes usam nossa navegação e nosso histórico nas mídias sociais para nos direcionar individualmente anúncios comerciais e politicos, o Clogger olharia em detalhes para você – e para centenas de milhões de outros eleitores – individualmente.

Ele ofereceria três passos a mais, em relação à atual manipulação de comportamento algorítmico de última geração. Primeiro, seu modelo de linguagem geraria mensagens – textos, mídia social e emails, talvez incluindo imagens e vídeos – personalizadas para você milimetricamente. Enquanto os anunciantes programam um número relativamente pequeno de anúncios para todos, modelos de linguagem como o ChatGPT podem gerar inúmeras mensagens exclusivas para cada pessoa ao longo de uma campanha.

Em segundo lugar, o Clogger usaria uma técnica chamada aprendizado por reforço para gerar uma sucessão de mensagens que se tornariam cada vez mais propensas a mudar seu voto. O aprendizado por reforço é uma abordagem de aprendizado de máquina, de tentativa e erro, na qual o computador realiza ações e obtém feedback sobre qual funciona melhor, até aprender como atingir um objetivo. Máquinas que podem jogar xadrez, go e muitos videogames melhor do que qualquer ser humano usaram o aprendizado por reforço.

Em terceiro lugar, ao longo de uma campanha, as mensagens do Clogger podem evoluir para levar em consideração suas respostas às comunicações anteriores da máquina e o que ela aprendeu sobre mudar a opinião dos outros. O Clogger seria capaz de manter “conversas” dinâmicas com você – e milhões de outras pessoas – ao longo do tempo. As mensagens do Clogger seriam semelhantes a anúncios que seguem você em diferentes sites e mídias sociais.

A natureza da IA

Mais três recursos são dignos de nota.

Primeiro, as mensagens que o Clogger envia podem ou não ter conteúdo político. O único objetivo da máquina é maximizar a parcela de votos. Por isso, ela provavelmente criaria estratégias para atingir esse objetivo nas quais nenhum ativista humano teria pensado.

Uma possibilidade é enviar aos eleitores prováveis de candidatos adversários informações sobre paixões não políticas que eles têm em esportes ou entretenimento para enterrar a mensagem política que recebem. Outra possibilidade é o envio de mensagens desconcertantes – por exemplo, anúncios de incontinência – programados para coincidir com as mensagens dos oponentes. E outra é manipular os grupos de amigos de mídia social dos eleitores para dar a impressão de que seus círculos sociais apóiam um determinado candidato.

Em segundo lugar, o Clogger não tem consideração pela verdade. Sequer tem como saber o que é verdadeiro ou falso. As “alucinações” dos sistemas tipo ChatGPT não são um problema para esta máquina, porque seu objetivo é mudar votos, não fornecer informações precisas.

Em terceiro lugar, por ser um tipo de inteligência artificial de caixa-preta, as pessoas não teriam como saber quais estratégias ela usa.

Democracia ou Clogocracia?

Se a campanha presidencial do Partido Republicano dos EUA implantasse o Clogger em 2024, a campanha democrata provavelmente seria obrigada a responder da mesma forma, talvez com uma máquina semelhante. Chame-o de Dogger. Se os gerentes de campanha julgassem essas máquinas eficazes, a disputa presidencial poderia se resumir a Clogger x Dogger, e o vencedor seria o cliente da máquina mais eficaz.

Cientistas políticos e especialistas teriam muito a dizer sobre por que uma ou outra IA prevaleceu, mas provavelmente ninguém realmente saberia. O presidente terá sido eleito não porque suas propostas ou ideias políticas políticas persuadiram mais eleitores, mas porque ele ou ela tinha a IA mais eficaz. O conteúdo que ganhou a parada teria vindo de uma IA focada apenas na vitória, sem ideias políticas próprias, e não de candidatos ou partidos.

Nesse sentido muito importante, uma máquina teria vencido a eleição, em vez de uma pessoa. A eleição não seria mais democrática, mesmo que todas as atividades ordinárias da democracia – os discursos, os anúncios, as mensagens, a votação e a apuração dos votos – tivessem ocorrido regularmente.

O presidente eleito pela IA poderia então seguir um de dois caminhos. Ele ou ela poderia usar o manto da eleição para seguir as políticas do partido republicano ou democrata. Mas como as ideias partidárias podem ter pouco a ver com o motivo pelo qual as pessoas votaram – Clogger e Dogger não se importam com opiniões políticas – as ações do presidente não refletiriam necessariamente a vontade dos eleitores. Os eleitores teriam sido manipulados pela IA em vez de escolher livremente seus líderes e políticas políticas.

Outro caminho é o presidente seguir as mensagens, comportamentos e políticas que a máquina prevê que maximizarão as chances de reeleição. Nesse rumo, o presidente não teria nenhuma plataforma ou agenda específica além de manter o poder. As ações do presidente, guiadas pelo Clogger, seriam as mais propensas a manipular os eleitores em vez de servir a seus interesses genuínos ou mesmo à própria ideologia do presidente.

Para evitar a Clogocracia

Seria possível evitar a manipulação eleitoral por IA se todos os candidatos, campanhas e consultores renunciassem ao uso político dos sistemas. Acreditamos que isso seja improvável. Se caixas-pretas politicamente eficazes forem desenvolvidas, a tentação de usá-las será quase irresistível. Na verdade, os consultores políticos poderão ver o uso dessas ferramentas como algo exigido por sua responsabilidade profissional de ajudar seus candidatos a vencer. E uma vez que um candidato use uma ferramenta tão eficaz, dificilmente se pode esperar que os oponentes resistam desarmando-se unilateralmente.

Uma proteção aprimorada da privacidade ajudaria. O Clogger dependeria do acesso a grandes quantidades de dados pessoais para atingir indivíduos, criar mensagens personalizadas para persuadi-los ou manipulá-los e rastreá-los e redirecioná-los ao longo de uma campanha. Cada pedacinho dessa informação que as empresas ou formuladores de políticas negassem à máquina a tornariam menos eficaz.

Outra solução está nos tribunais eleitorais. Eles poderiam tentar proibir ou regular severamente essas máquinas. Há um debate acirrado sobre se esse discurso “replicante” , mesmo que de natureza política, pode ser regulamentado. Em países como os EUA, a defesa extremista da liberdade de expressão leva muitos acadêmicos importantes a dizer que não .

Mas não há razão para estender automaticamente a garantia da liberdade de expressão ao produto dessas máquinas. Qualquer país pode optar por conceder direitos às máquinas, mas essa decisão deve ser baseada nos desafios de hoje, não na suposição equivocada de que os autores das Declarações de Direitos Humanos pretendiam que elas fossem aplicadas à IA…

Os reguladores da União Européia estão se movendo nessa direção. Um rascunho do Parlamento Europeu para a Lei de Inteligência Artificial está sendo revisado e deverá tratar os “sistemas de IA construídos para influenciar os eleitores” como de “alto risco”, e portanto sujeitos a escrutínio regulatório.

Uma medida constitucionalmente mais segura, embora menor, já adotada em parte pelos reguladores da Internet na União Europeia e na Califórnia, é proibir que os bots se façam passar por pessoas. Por exemplo, a regulamentação pode exigir que as mensagens de campanha venham com isenções de responsabilidade quando o conteúdo delas for gerado por máquinas e não por humanos.

Isso seria como os requisitos de identificação de autoria, nas peças de campanha eleitoral – “Produzido pelo comitê eleitoral do candidato X” – porém modificados para refletir sua origem de IA: “Este anúncio gerado por Inteligência Artificial foi pago pelo candidato X”. Uma versão mais forte poderia exigir: “Esta mensagem gerada por IA está sendo enviada a você pelo candidato X, porque o Clogger previu que isso aumentará as chances de você votar nele”. Acreditamos que os eleitores merecem saber, no mínimo, quando quem fala com eles é um bot, e também devem saber por quê.

A possibilidade de criar um sistema como o Clogger mostra que o caminho para o desempoderamento coletivo das sociedades pode não exigir nenhuma inteligência artificial geral sobre-humana. Bastas que consultores e ativistas ansiosos tenham a seu dispor novas ferramentas, capazes de efetivamente apertar os muitos botões de milhões de pessoas.

Archon Fung e Lawrence Lessig

Archon Fung é cientista político na Kennedy School da Universidade de Harvard. Co-fundou o Transparency Policy Project.

Lawrence Lessig é advogado e professor de Direito na Universidade de Harvard. É o fundador da Fundação Creative Commons, que se dedica à defesa da livre circulação de conhecimento, em especial na internet, e à busca de alternativas às leis de propriedade intelectual.